Chiński model AI o otwartych wagach Kimi K2.6 pokonał najbardziej zaawansowane modele od OpenAI, Anthropic i Google w konkursie programistycznym. W 12. dniu trwającego AI Coding Contest model od startupu Moonshot AI zajął pierwsze miejsce, wyprzedzając GPT-5.5, Claude Opus 4.7 i Gemini Pro 3.1. Szczegółowe wyniki konkursu opublikował portal ThinkPol.

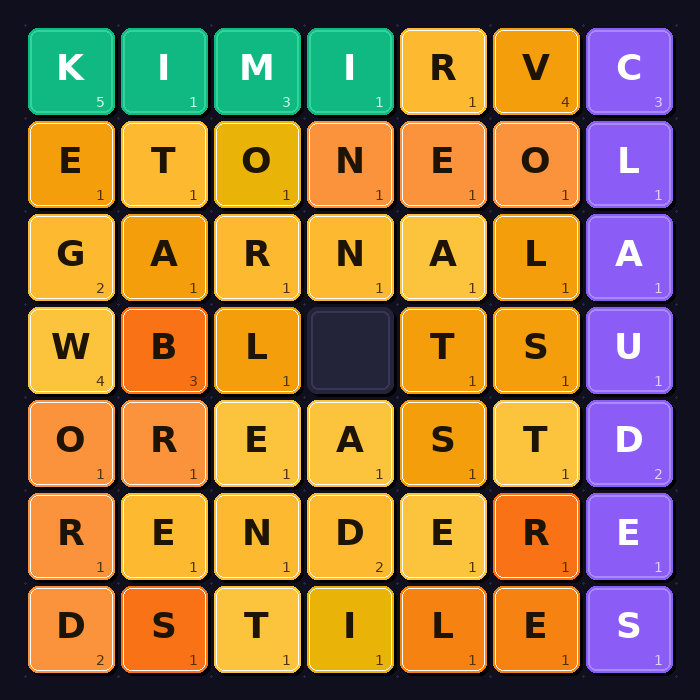

Konkurs polegał na rozwiązywaniu Word Gem Puzzle — układanki z przesuwanymi kafelkami z literami, gdzie modele musiały znajdować angielskie słowa na planszy i zdobywać punkty za ich długość.

Kluczowe wnioski

- Kimi K2.6 wygrał z wynikiem 22 punktów meczowych i bilansem 7–1-0, pokonując wszystkie modele z zachodnich laboratoriów AI.

- MiMo V2-Pro od Xiaomi zajął drugie miejsce (20 punktów), a GPT-5.5 trzecie (16 punktów) — Claude Opus 4.7 skończył dopiero na piątej pozycji.

- Zwycięska strategia Kimi polegała na agresywnym przesuwaniu kafelków w poszukiwaniu nowych słów, podczas gdy większość konkurentów w ogóle nie przesuwała elementów.

- Wyniki pokazują, że nie wszystkie chińskie modele dominowały — DeepSeek V4 zajął przedostatnie miejsce, a zwycięstwo należy przypisać konkretnym modelom, nie całemu regionowi.

- Scoring penalizował krótkie słowa (słowa 3-literowe kosztowały 3 punkty), nagradzając tylko słowa siedmioliterowe lub dłuższe.

Zasady konkursu i strategia zwycięzcy

Word Gem Puzzle to układanka na prostokątnej planszy (od 10×10 do 30×30) wypełnionej kafelkami z literami i jednym pustym miejscem. Modele mogły przesuwać sąsiadujące kafelki w puste pole i zgłaszać prawidłowe angielskie słowa ułożone w liniach poziomych lub pionowych. System punktacji nagradzał długie słowa (słowo ośmioliterowe = 2 punkty), a karał krótkie (słowo trzyliterowe = -3 punkty).

Kimi K2.6 zastosował strategię zachłanną: oceniał każdy możliwy ruch pod kątem odblokowania nowych słów o dodatniej wartości, wykonywał najlepszy i powtarzał proces. Gdy żaden ruch nie dawał pozytywnych słów, wybierał pierwszy dozwolony kierunek alfabetycznie. Na większych planszach 30×30, gdzie początkowe słowa były mocno przemieszane, intensywne przesuwanie w końcu się opłaciło — Kimi uzyskał najwyższą łączną liczbę punktów w turnieju: 77.

Kontrastujące podejścia konkurencji

MiMo V2-Pro przyjął całkowicie odmienną strategię — w ogóle nie przesuwał kafelków. Zamiast tego skanował początkową planszę w poszukiwaniu słów siedmioliterowych lub dłuższych i wysyłał wszystkie znalezione w jednym pakiecie TCP. Ta krucha strategia działała tylko na planszach, gdzie pomieszanie pozostawiało nienaruszone słowa-zalążki.

Claude również nie przesuwał elementów, co okazało się prawdziwym ograniczeniem w układance zbudowanej wokół przesuwania. GPT-5.5 był bardziej konserwatywny z około 120 przesunięciami na rundę i pokazał najlepsze wyniki na planszach 15×15 i 30×30. GLM 5.1 był najagresywniejszy w całym turnieju z ponad 800 000 łącznych przesunięć, ale blokował się, gdy zabrakło mu ruchów o dodatniej wartości.

Na przeciwnym biegunie znalazł się model Muse Spark, który zgłaszał każde znalezione słowo niezależnie od długości. Na planszy 30×30 z setkami widocznych krótkich słów Muse znajdował je wszystkie i tracił punkty za każde. Jego łączny wynik wyniósł -15 309 punktów — gorszy niż gdyby w ogóle się nie podłączył.

Wyniki pokazują, że sukces w zadaniach programistycznych nie zawsze koreluje z rozpoznawalnością marki czy zasobami laboratoriów AI. Kimi K2.6, dostępny jako model o otwartych wagach, udowodnił, że przemyślana strategia może przeważyć nad surową mocą obliczeniową.