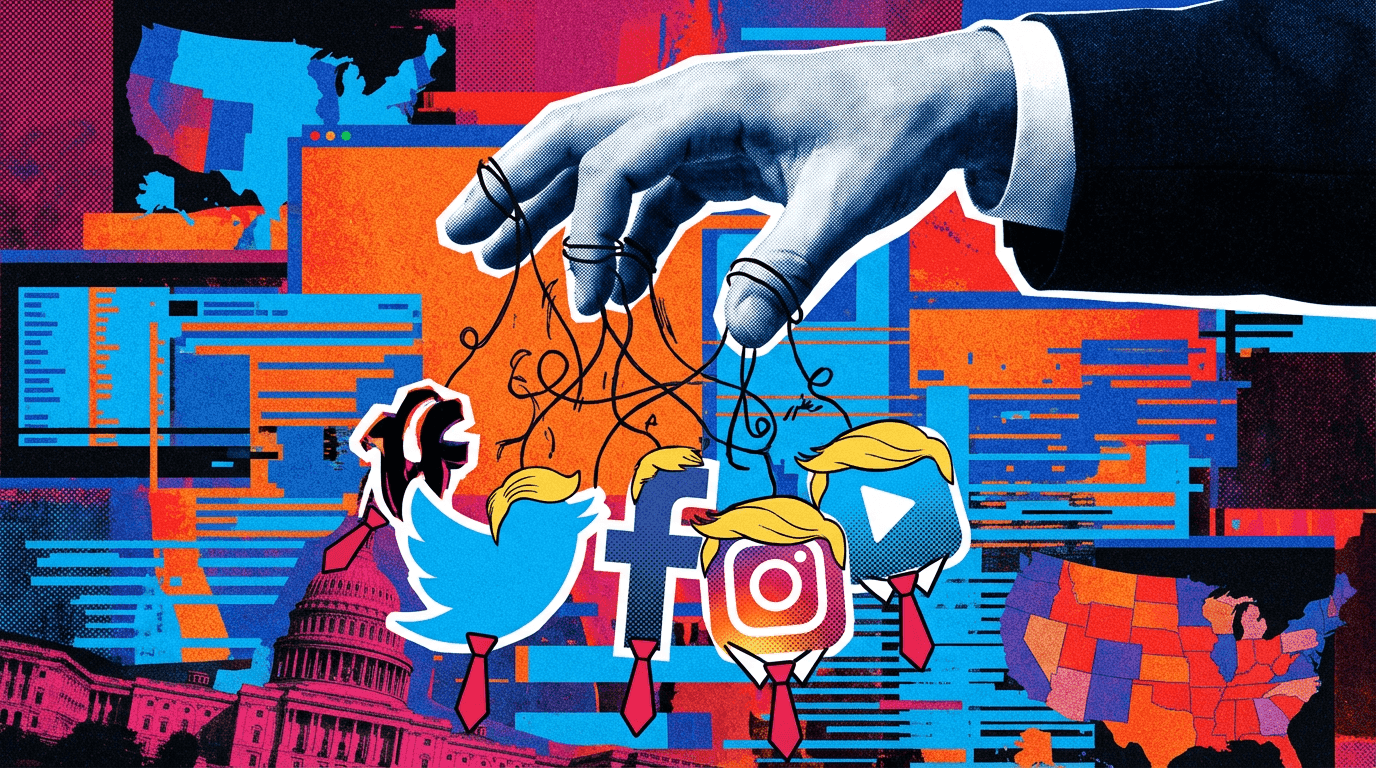

Przed nadchodzącymi wyborami do połowy kadencji w USA media społecznościowe zostały zalane fałszywymi kontami prowadzonymi przez sztuczną inteligencję, które rozpowszechniają treści pro-trumpowskie. Badanie przeprowadzone przez New York Times ujawniło skalę tego zjawiska i jego potencjalny wpływ na wybory.

Według raportu, setki fałszywych kont z awatarami generowanymi przez AI pojawiły się w mediach społecznościowych, atakując "radykalną lewicę" i promując hasła "America First". Samo badanie New York Times zidentyfikowało co najmniej 304 takie konta na TikToku od stycznia tego roku.

Kluczowe wnioski

- Masowa skala operacji: Zidentyfikowano łącznie ponad 325 fałszywych kont AI na różnych platformach (TikTok, Instagram, Facebook, YouTube)

- Znaczący zasięg: Niektóre konta zgromadziły ponad 35 000 obserwujących, a pojedyncze posty osiągnęły ponad pół miliona wyświetleń

- Niska bariera wejścia: Koszt produkcji pojedynczego posta wynosi jedynie 1-3 dolary, a jedna osoba może obsługiwać wiele kont

- Jednostronny charakter: Nie wykryto porównywalnych sieci kont lewicowych

- Problem globalny: Podobne zjawiska zaobserwowano w Japonii podczas ostatnich wyborów

Anatomia fałszywych influencerów

Laboratotium GRAIL z Uniwersytetu Purdue odnalazło dodatkowo tuzin kont na TikToku, Instagramie i Facebooku, podczas gdy analityk Eric Nelson z firmy bezpieczeństwa Alethea wykrył dziewięć na YouTube. Przykłady obejmują konto TikTok @perezfernandaus oraz już usunięte konto Instagram "jessicaa.foster".

Charakterystyczne dla tych operacji jest powtarzanie identycznych elementów - te same postacie pojawiają się na różnych kontach, jak blondynka z warkoczykami na farmie czy czarnoskóra kobieta w czerwonej czapce MAGA i okularach pilota. Konta używają identycznego języka, zdjęć profilowych i efektów dźwiękowych, a niektóre nawet wzajemnie się obserwują.

Zuhair Lakhani, współzałożyciel startupu reklamowego Doublespeed, wyjaśnił New York Times, że każdy post kosztuje prawdopodobnie jedynie 1-3 dolary, a jedna osoba może z łatwością obsługiwać całą operację.

TikTok określa te konta jako spam i zapowiada ich usunięcie, argumentując, że nie ma "żadnych oznak ukrytych operacji wpływu", a jedynie spamerzy gonią za zaangażowaniem. Jednak New York Times wskazuje na klastry kont używających identycznych elementów, co sugeruje skoordynowaną akcję.

Problem nie ogranicza się do Stanów Zjednoczonych. Fałszywe filmy i wiadomości AI rozprzestrzeniały się również w mediach społecznościowych w Japonii podczas ostatnich wyborów do izby niższej. Badanie przeprowadzone przez profesora Shinichi Yamaguchi z International University of Japan wykazało, że 51,5 procent respondentów uwierzyło w prawdziwość takich fake newsów.

Zjawisko AI-generowanych influencerów politycznych pokazuje, jak niska bariera technologiczna i finansowa może prowadzić do masowej dezinformacji w kluczowych momentach demokratycznych procesów.