Zespół badaczy z Alec Radfordem na czele stworzył „talkie” — model językowy o 13 miliardach parametrów, trenowany wyłącznie na tekstach opublikowanych przed 1931 rokiem. Ten nietypowy eksperyment pokazuje, jak sztuczna inteligencja widzi świat z perspektywy wczesnego XX wieku. Szczegóły projektu opisuje portal The Decoder.

Kluczowe wnioski

- Model „talkie” został wytrenowany na 260 miliardach tokenów z książek, gazet, czasopism naukowych i dokumentów prawnych sprzed 1931 roku.

- Na pytanie o rok 2026 model przewiduje świat zdominowany przez parowce, sieci kolejowe i Europa z miliardową populacją.

- Sztuczna inteligencja uważa drugą wojnę światową za mało prawdopodobną, twierdząc że „szaleństwo z lat 1914–1918 przeminęło”.

- Zespół planuje skalowanie modelu do poziomu GPT-3 do lata 2026 roku.

- Vintage modele mogą służyć jako czyste środowisko testowe, wolne od kontaminacji danymi z internetu.

Wizja przyszłości z perspektywy 1930 roku

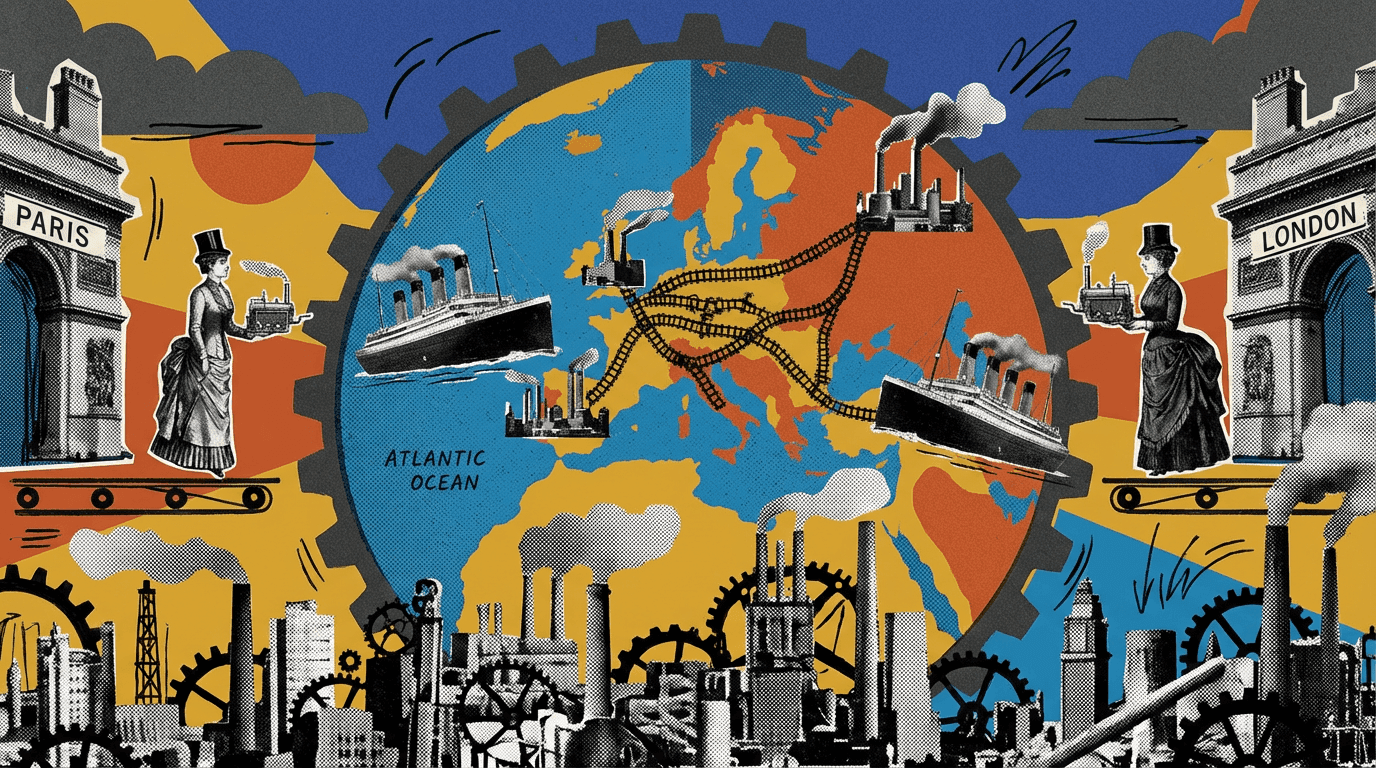

Gdy zapytano model o świat w 2026 roku, jego odpowiedź brzmi jak fragment powieści science fiction z epoki wiktoriańskiej. Europa ma liczyć miliard mieszkańców, żelazne koleje mają przecinać kontynent, a parowce będą łączyć Londyn z Nowym Jorkiem w ciągu dziesięciu dni. Model przewiduje także, że „zima będzie spędzana w Paryżu, a lato w Londynie”.

Szczególnie interesująca jest perspektywa modelu na możliwość wybuchu drugiej wojny światowej. Talkie kategorycznie stwierdza, że kolejny konflikt światowy jest mało prawdopodobny, ponieważ „szaleństwo z lat 1914–1918 przeminęło”, a narody „mają dość wojny i zwracają się ku pokojowym zajęciom”.

Model nie jest jednak całkowicie naiwny — ostrzega przed „tlącymi się animozjami” i „łatwopalnymi materiałami” rozrzuconymi po Europie, wskazując na potencjalne punkty zapalne między Chinami a Japonią czy Włochami a Jugosławią.

Wyzwania techniczne i metodologia

Zespół badaczy stanął przed unikalnymi wyzwaniami. Jako datę graniczną wybrano koniec 1930 roku, ponieważ wtedy dzieła wchodzą do domeny publicznej w Stanach Zjednoczonych. Każdy tekst musiał zostać przepisany z fizycznych źródeł, co spowodowało poważne problemy z jakością.

W kontrolowanych eksperymentach standardowe transkrypcje OCR osiągały tylko 30 procent wydajności modelu trenowanego na transkrypcjach ludzkich przy tym samym budżecie obliczeniowym. Proste czyszczenie regex zwiększyło ten wynik do 70 procent. Zespół opracowuje dedykowany system OCR dla tekstów vintage, aby zmniejszyć pozostałą różnicę.

Innym wyzwaniem było zapewnienie, że wiedza z późniejszych epok nie przedostanie się do danych treningowych. Książka z 1925 roku mogła otrzymać zaktualizowany przedmowy w wydaniu z 1960 roku, katalogi biblioteczne czasami podają błędną datę publikacji, a przypisy czy komentarze mogą być dodane do tekstu historycznego długo po jego napisaniu.

Możliwości programistyczne bez znajomości komputerów

Zespół przetestował również, czy model bez wiedzy o komputerach cyfrowych może opanować nowoczesne języki programowania. W benchmarku HumanEval dla Pythona vintage modele radzą sobie znacznie gorzej od współczesnych odpowiedników, ale stale się poprawiają wraz ze skalowaniem.

Każde poprawne rozwiązanie to prosty jednolinijkowiec lub drobna modyfikacja przykładowego programu. Talkie poprawnie zaimplementował funkcję dekodującą szyfr rotacyjny, zamieniając dodawanie na odejmowanie — co wskazuje na podstawowe zrozumienie funkcji odwrotnych.

Vintage modele, wolne z założenia od kontaminacji danych, nadają się idealnie do eksperymentów z generalizacją. Wszystkie współczesne modele językowe są trenowane bezpośrednio lub pośrednio na danych internetowych, co kształtuje ich zdolności w sposób trudny do precyzyjnego określenia.

Model talkie jest dostępny jako wersja bazowa i czatowa na Hugging Face, z kodem na GitHubie. Można go również przetestować na żywo na stronie projektu. Zespół planuje skalowanie do poziomu GPT-3 i dalsze badania nad tym, jakie cechy modeli językowych są uniwersalne, a które wynikają ze specyficznego korpusu treningowego.